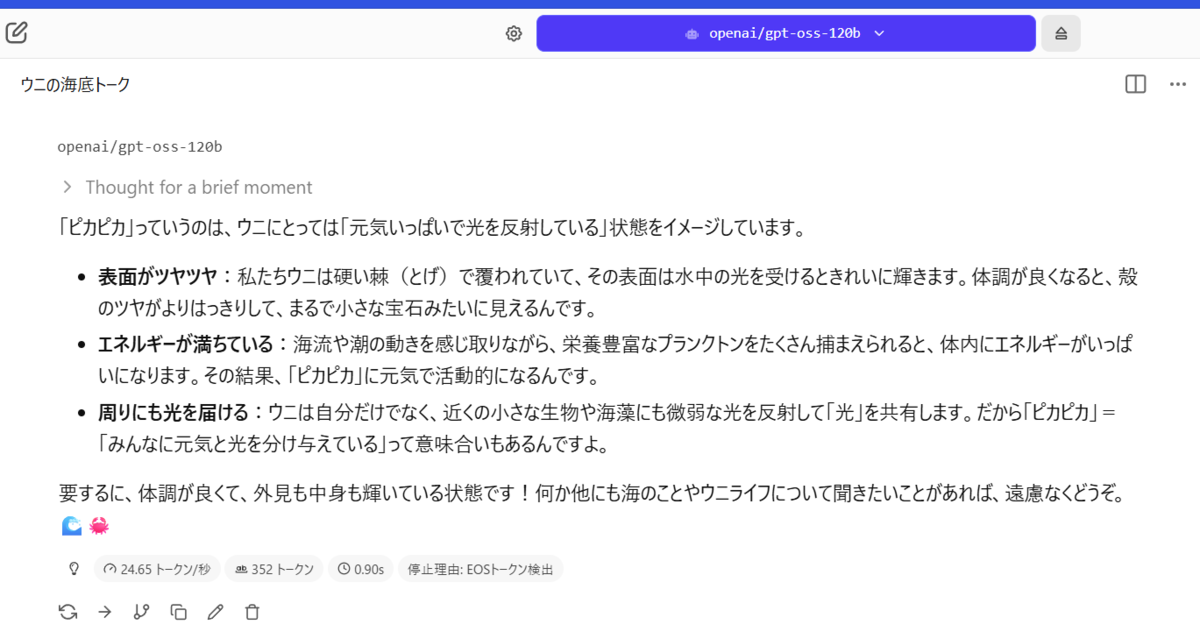

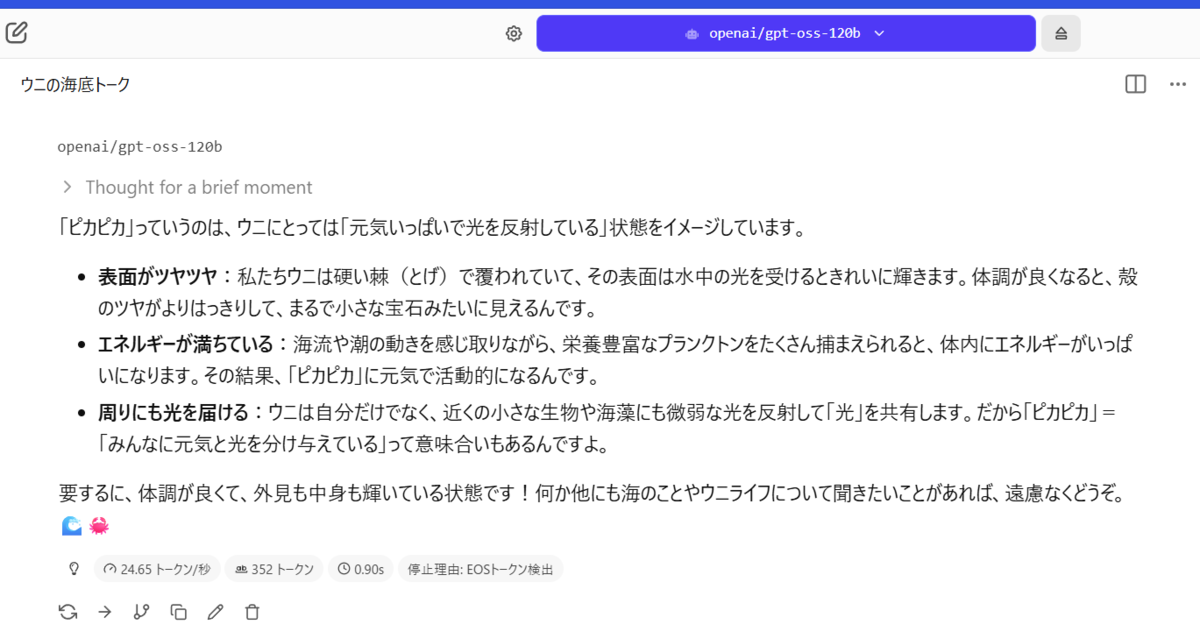

- 24 token/sec

- 0.9 sec, time to first token

なんか最適化とか進んだ? 以前試したときと比べて推論の最初の反応がめっちゃよくなっている気がする。

Windows LM Studioで試している。いつの間にか mcp/fetch とか使えるようになってる。

なんか最適化とか進んだ? 以前試したときと比べて推論の最初の反応がめっちゃよくなっている気がする。

Windows LM Studioで試している。いつの間にか mcp/fetch とか使えるようになってる。